ทำไมไทยต้องมีกฎหมาย AI

ปี 2026 AI ไม่ใช่เทคโนโลยีในห้องทดลองอีกต่อไป — มันอยู่ในแอปธนาคาร ระบบจ้างงาน ระบบยุติธรรม และแม้แต่การตัดสินใจทางการแพทย์ ในขณะที่ประเทศไทยยังไม่มีกรอบกฎหมายที่ชัดเจนในการกำกับดูแล AI ซึ่งต่างจาก สหภาพยุโรป ที่บังคับใช้ EU AI Act แล้ว และ เกาหลีใต้ ที่ประกาศใช้ AI Basic Act ตั้งแต่มกราคม 2026 ในฐานะประเทศแรกในเอเชีย

จนกระทั่ง กระทรวงดิจิทัลเพื่อเศรษฐกิจและสังคม (DE) ร่วมกับ สำนักงานพัฒนาธุรกรรมทางอิเล็กทรอนิกส์ (ETDA) ได้เปิด (ร่าง) หลักการกฎหมายว่าด้วยปัญญาประดิษฐ์ ฉบับแรกของไทยขึ้นมา โดยเป้าหมายคือให้กฎหมายนี้มีผลบังคับใช้จริงภายในปี 2026

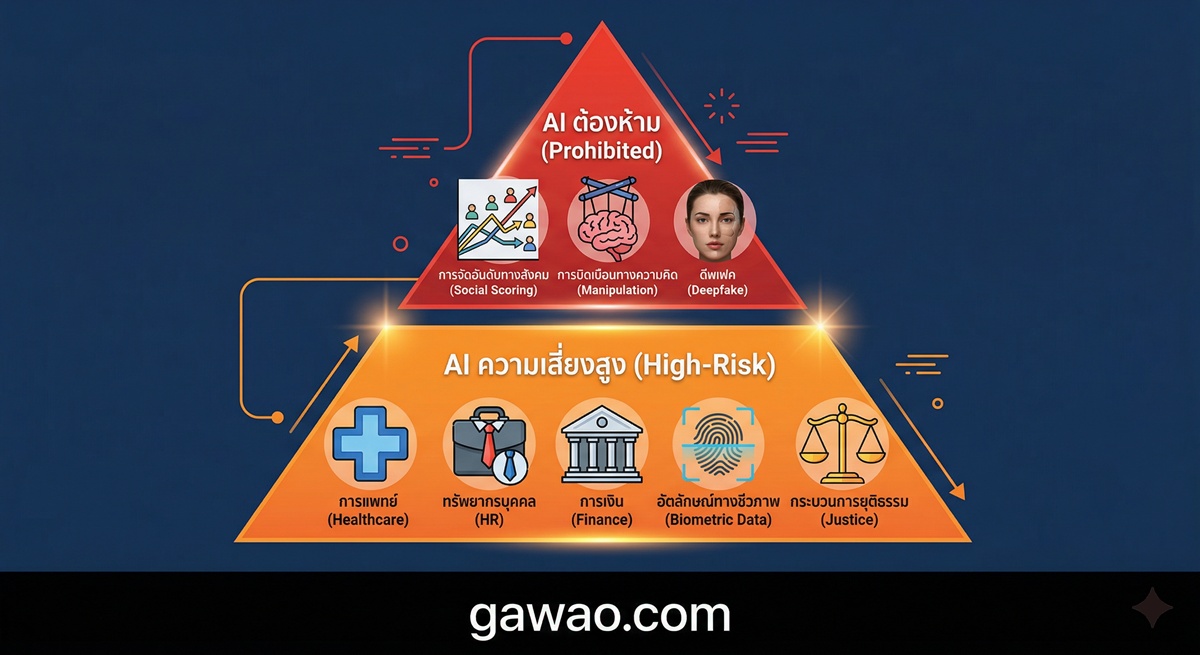

สาระสำคัญ: แบ่ง AI เป็น 2 ระดับความเสี่ยง

หัวใจของร่างกฎหมายนี้คือแนวคิด Risk-based Approach หรือการกำกับตามระดับความเสี่ยง โดยอ้างอิงจาก EU AI Act เป็นหลัก แบ่ง AI ออกเป็น 2 กลุ่ม

กลุ่มที่ 1: AI ที่ “ต้องห้าม” (Prohibited-Risk AI)

คือระบบ AI ที่ก่อให้เกิดอันตรายร้ายแรงจนไม่สามารถบรรเทาความเสี่ยงได้ — ห้ามใช้โดยเด็ดขาด

| ตัวอย่าง AI ที่ต้องห้าม | เหตุผล |

|---|---|

| Social Scoring — ให้คะแนนพลเมืองตามพฤติกรรมแล้วจำกัดสิทธิ์ | ละเมิดสิทธิมนุษยชนขั้นพื้นฐาน |

| Subliminal Manipulation — AI ที่แอบชักจูงพฤติกรรมโดยเหยื่อไม่รู้ตัว | เช่น ระบบที่ใช้จุดอ่อนทางจิตใจ ดึงคนเข้าสู่การพนันหรือสินเชื่อดอกเบี้ยโหด |

| AI สร้าง Deepfake เนื้อหาลามกหรือข่าวปลอม ที่กระทบสังคมหรือกระบวนการเลือกตั้ง | ทำลายความน่าเชื่อถือของสถาบันและกระบวนการประชาธิปไตย |

ผู้ฝ่าฝืนอาจได้รับ โทษทางอาญา และ โทษปรับทางปกครอง รวมถึงการสั่งยึดอุปกรณ์ที่ฝัง AI ต้องห้าม และหากเป็นบริการออนไลน์ อาจสั่ง ISP บล็อกการเข้าถึง ภายในประเทศไทย

กลุ่มที่ 2: AI “ความเสี่ยงสูง” (High-Risk AI)

คือระบบ AI ที่อาจกระทบสิทธิขั้นพื้นฐานหรือความปลอดภัยสาธารณะ แต่ อนุญาตให้ใช้ได้ หากปฏิบัติตามข้อกำหนดอย่างเข้มงวด

| ตัวอย่าง High-Risk AI | ข้อกำหนดที่ต้องปฏิบัติ |

|---|---|

| AI วินิจฉัยโรค / สั่งยา | ต้องมีระบบบริหารความเสี่ยง, ติดฉลากแจ้งว่าใช้ AI |

| AI คัดกรองผู้สมัครงาน | ต้องอธิบายได้ว่าตัดสินใจอย่างไร (Explainability) |

| AI ตัดสินใจอนุมัติสินเชื่อ | ต้องมีระบบรายงานเหตุการณ์ผิดปกติ |

| AI ระบุตัวตนด้วย Biometric | ต้องมีตัวแทนทางกฎหมายในไทย |

| AI ในกระบวนการยุติธรรม | ต้องรับผิดชอบต่อความเสียหายที่เกิดขึ้น |

AI Sandbox — พื้นที่ทดลองนวัตกรรมโดยไม่ต้องกลัวโดนลงโทษ

หนึ่งในจุดเด่นที่สุดของร่างกฎหมายนี้คือการจัดตั้ง AI Regulatory Sandbox — พื้นที่ทดลองที่อนุญาตให้สตาร์ทอัพ บริษัทเทคโนโลยี และนักวิจัย ทดสอบระบบ AI ใหม่ภายใต้กรอบที่ควบคุมได้ โดยไม่ต้องรับโทษตามกฎหมายในช่วงทดลอง

เป้าหมายคือไม่ให้กฎหมายกลายเป็น “กำแพง” ที่กั้นนวัตกรรม แต่เป็น “ราวกั้น” ที่ให้ทดลองได้อย่างปลอดภัย นอกจากนี้ร่างกฎหมายยังเสนอมาตรการส่งเสริมอื่นๆ เช่น การสร้างมาตรฐานข้อมูลเปิด (Open Data) เพื่อสนับสนุนการพัฒนา AI ในประเทศ

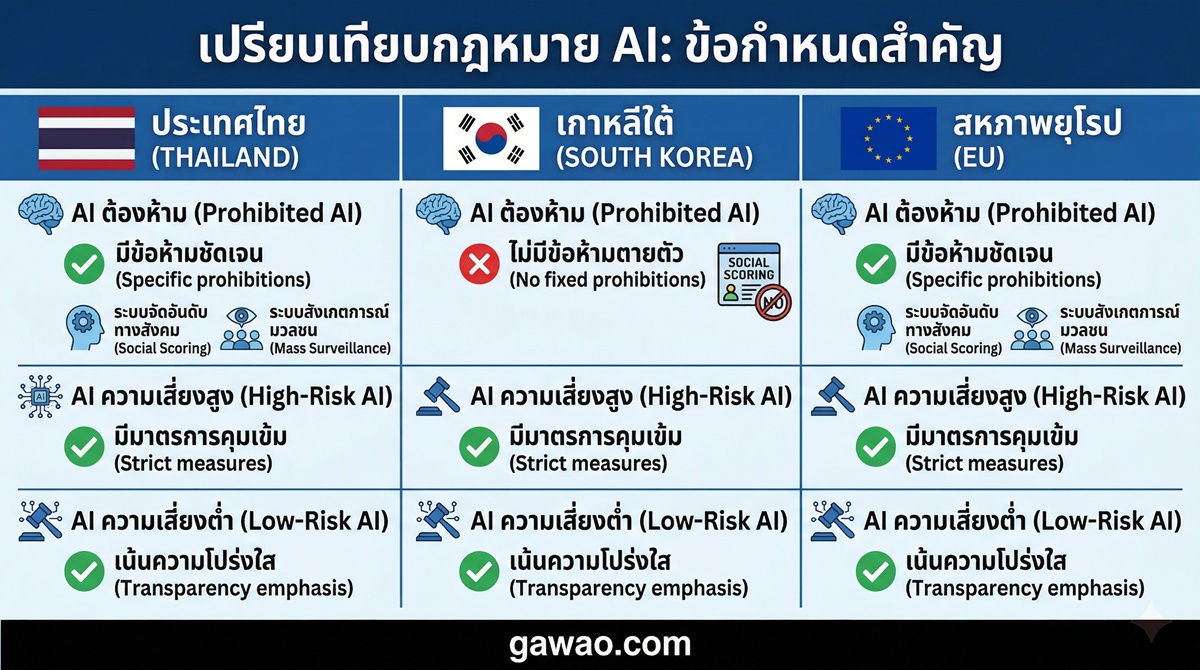

เปรียบเทียบ: ไทย vs เกาหลีใต้ vs สหภาพยุโรป

| เกณฑ์ | ไทย (ร่าง 2026) | เกาหลีใต้ AI Basic Act | EU AI Act |

|---|---|---|---|

| สถานะ | ร่าง — คาดบังคับใช้ปี 2026 | บังคับใช้ ม.ค. 2026 | บังคับใช้แล้ว |

| AI ต้องห้าม | มี — Social Scoring, Manipulation | ไม่มี | มี — คล้ายไทย |

| AI ความเสี่ยงสูง | มี — ต้องปฏิบัติตามข้อกำหนด | มี — ต้องแจ้งผู้ใช้ | มี — เข้มงวดมาก |

| Sandbox | มี | มี | มี |

| บทลงโทษ | อาญา + ปรับปกครอง | ปรับ ~730,000 บาท | ปรับสูงสุด 35M ยูโร |

| ครอบคลุมผู้ใช้ AI | คาดว่าจะครอบคลุม | ไม่ครอบคลุม (เฉพาะผู้พัฒนา) | ครอบคลุมทั้งหมด |

| ระยะผ่อนผัน | รอประกาศ | 1 ปี | แตกต่างตามระดับ |

จุดที่น่าสนใจคือ เกาหลีใต้ไม่มีหมวด AI ต้องห้ามเลย ซึ่งต่างจากไทยและ EU ที่กำหนดไว้ชัดเจน และกฎหมายเกาหลีใต้ไม่ครอบคลุม “ผู้ใช้ AI” เช่น โรงพยาบาลหรือธนาคาร แต่ไทยคาดว่าจะครอบคลุมกว้างกว่า

กระทบใครบ้าง

บริษัทเทคโนโลยี / สตาร์ทอัพ AI ต้องเตรียมจัดระดับความเสี่ยงของผลิตภัณฑ์ AI ตั้งแต่ตอนนี้ หากผลิตภัณฑ์อยู่ในกลุ่ม High-Risk ต้องเตรียมระบบ Risk Management, Explainability และ Incident Reporting ให้พร้อม

ธนาคารและสถาบันการเงิน ที่ใช้ AI อนุมัติสินเชื่อ, ตรวจจับ Fraud หรือ Biometric Verification จะอยู่ในกลุ่ม High-Risk แน่นอน ต้องเตรียมตัวปฏิบัติตามข้อกำหนด

โรงพยาบาลและคลินิก ที่ใช้ AI วินิจฉัยโรคหรือแนะนำการรักษา จะต้องมีระบบที่อธิบายได้ว่า AI ตัดสินใจอย่างไร และต้องรับผิดชอบหากเกิดความผิดพลาด

แพลตฟอร์มโซเชียลมีเดีย ที่ใช้ Algorithm ในการแนะนำเนื้อหา อาจต้องเปิดเผยวิธีการทำงานของ AI มากขึ้น

ประชาชนทั่วไป จะได้รับการคุ้มครองมากขึ้นจาก AI ที่อาจละเมิดสิทธิ์ โดยเฉพาะ Deepfake, การจัดอันดับทางสังคม และการชักจูงพฤติกรรมแบบแอบแฝง

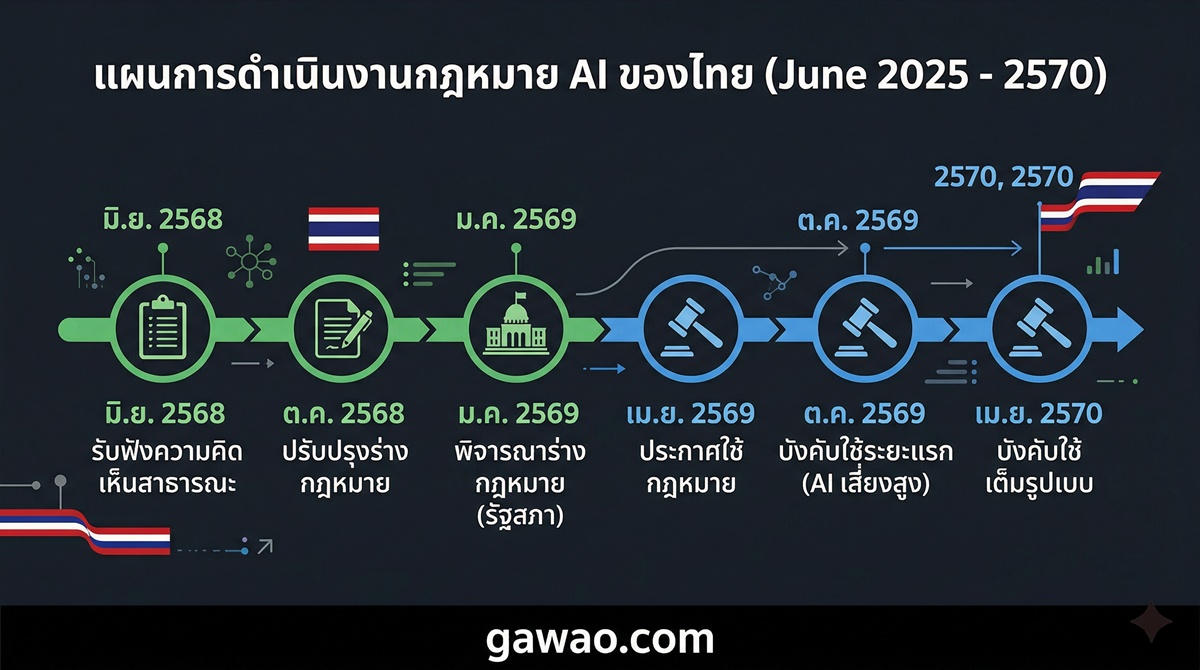

ไทม์ไลน์ที่ต้องจับตา

| ช่วงเวลา | เหตุการณ์ |

|---|---|

| มิ.ย. 2025 | ETDA เปิดรับฟังความคิดเห็นร่างหลักการกฎหมาย AI |

| ปลายปี 2025 | ปรับปรุงร่างตามความคิดเห็น อาจเปิดรับฟังรอบที่ 2 |

| ปี 2026 | เสนอร่างกฎหมายฉบับจริงเข้าสู่กระบวนการนิติบัญญัติ |

| 2026–2027 | คาดว่ามีผลบังคับใช้ พร้อมระยะผ่อนผัน |

สรุป

ร่างกฎหมาย AI ฉบับแรกของไทยเป็นก้าวสำคัญที่แสดงให้เห็นว่ารัฐบาลเริ่มตื่นตัวกับความเสี่ยงของ AI อย่างจริงจัง การแบ่งระดับความเสี่ยงเป็น “ต้องห้าม” กับ “ความเสี่ยงสูง” เป็นแนวทางที่สอดคล้องกับมาตรฐานสากล ขณะที่ Sandbox ช่วยให้นวัตกรรมไม่ถูกตีกรอบจนเกินไป สิ่งที่ต้องจับตาคือรายละเอียดบทลงโทษและขอบเขตการบังคับใช้จริง ซึ่งจะชัดเจนขึ้นเมื่อร่างกฎหมายฉบับเต็มถูกเสนอเข้าสู่กระบวนการนิติบัญญัติ

แหล่งอ้างอิง:

- ETDA — ครั้งแรกของไทย! เปิด (ร่าง) หลักการกฎหมาย AI

- The Standard — ไทยเปิดร่างกฎหมาย AI ฉบับแรก เน้นคุมความเสี่ยงสูง

- The Active / Thai PBS — DE เปิดรับฟังความเห็น ร่างกฎหมาย AI

- ThaiPublica — กฎหมายว่าด้วย AI ฉบับแรกของเอเชีย

- Norton Rose Fulbright — Thailand’s draft AI law: A new era for governance and innovation

- Chiang Rai Times — Thailand’s New AI Laws: Business Compliance Guide 2026

- TDRI — การเดินหน้ากฎหมายปัญญาประดิษฐ์ของไทย

เผยแพร่บน: gawao.com | AI, Law & Regulation, Digital Policy | 24 มีนาคม 2026